Автоматические стратегии в Google Ads: добро или зло? — эксперимент

Задумав протестировать автоматические стратегии, PPC Manager AdStudio Илья Щедрый решил сделать это на брендовых кампаниях в десяти странах. Что из этого вышло — в этом материале.

Автоматические стратегии назначения ставок в Google Ads активно продвигаются самой Google уже 3–4 года. По информации компании, стратегии позволяют экономить время за счет использования модного нынче машинного обучения. Сейчас в Google Ads существуют стратегии для самых распространенных задач рекламодателей:

- Управление видимостью: «Целевой процент полученных показов».

- Управление трафиком: «Максимальное количество кликов», «Оптимизатор цены за конверсию».

- Управление конверсиями: «Целевая цена за конверсию», «Целевая рентабельность инвестиций в рекламу», «Максимум конверсий».

Каждый рекламодатель, обозначив приоритетную задачу, может выбрать нужную стратегию и проверить, насколько хорошо она справляется со своей задачей по сравнению с ручным управлением ставками. Для этой цели удобно использовать функцию эксперимента с разделением трафика 50/50. Это позволит стратегии обучиться в течение двух недель без значительной потери производительности в целом: экспериментальная кампания обучается на 50% трафика, пока вторые 50% трафика идут по контрольной версии кампании и имеют прежнюю эффективность. Именно так поступил и я, когда решил проверить работу стратегии «Максимум конверсий» на брендовых кампаниях, работавших со стратегией «Оптимизатор цены за конверсию» на протяжении многих лет.

Под брендовыми кампаниями следует понимать те, что таргетируются на ключевые слова с названием компании. «Купить ноутбук розетка» или «электросамокат цитрус» — это примеры брендовых запросов. Многие PPC-специалисты не понимают, зачем нужны брендовые кампании: если у сайта уже есть базовая оптимизация, то будут и первые позиции по таким запросам. Что ж, отвечу ссылкой на статью, а здесь уточню, почему они используются именно в этом проекте:

- Экспериментально доказана лишь частичная каннибализация трафика на уровне 5–6%.

- В проекте часто — несколько раз в неделю — меняются офферы по продуктам: проводятся распродажи, запускаются спецпредложения и т. д. Ссылки на них крайне удобно размещать в брендовых рекламных кампаниях, информируя посетителей сайта об этих акциях.

- Компания работает в нескольких странах, и поэтому бренд часто пишут с ошибкой. Иногда — если в запросе допущена ошибка — нашего сайта нет на первой позиции в органической выдаче.

- Продукты-бестселлеры, меняющиеся каждый месяц, удобно размещать в уточнениях вместе с ценой (она автоматически подтягивается с сайта). Получается торговая мини-кампания по брендовым запросам.

- Конкуренты нет-нет, да иногда показывают рекламу по запросам компании.

Итак, вооружившись справочными материалами Google по автоматическим стратегиям назначения ставок и прочитав их вдоль и поперек, я решил проверить, смогут ли автоматические стратегии привлечь больше конверсий с брендовых кампаний, чем это делает «Оптимизатор цены за конверсию»? Именно этот вопрос и встал во главу всего эксперимента.

Об эксперименте

- Количество тестируемых кампаний — 10, каждая нацелена на отдельную страну.

- Бюджет каждой кампании не ограничен ввиду запредельной рентабельности кампаний.

- Метод разделения трафика — 50/50%.

- Сезон тестирования — переходный, не пик и не дно.

- Исторические данные по каждой кампании включали не менее 10 000 конверсий (транзакций), собранных за годы работы.

- Модель атрибуции для оценки эксперимента — data-driven.

- Срок эксперимента — 45 дней: 15 дней на обучение стратегии, 30 дней — на тестирование.

- Тематика — мультибрендовый e-commerce в сегменте B2C, цифровые продукты: различный софт, игры, ваучеры и т. д.

Согласно цели эксперимента, единственным измененным параметром была стратегия назначения ставок: было — «Оптимизатор цены за конверсию», стало — «Максимум конверсий». Ожидалось, что последняя за счет технологий машинного обучения сможет дать по крайней мере 3–5% прирост производительности кампаний благодаря корректировке ставок по регионам внутри стран, устройствам (сейчас по некоторым снижены из-за плохого показателя конверсии на сайте) и так далее. В крайнем случае мы ожидали, что эффективность не изменится. Но то, что произошло на самом деле, я и представить не мог.

Перед вами таблица с результатами эксперимента, состоящая из трех секций для каждой кампании, где Control — контрольная версия кампании, Experiment — экспериментальная, Diff — разница между показателями этих версий в процентах. Зеленый цвет означает рост показателя, а красный — его снижение.

|

Country |

Type |

Conv. |

CPA* |

CR |

Clicks |

CPC* |

CTR |

Cost* |

|---|---|---|---|---|---|---|---|---|

|

Market 1 |

Control |

131,7 |

6,15 |

5,68% |

2318 |

0,35 |

43,49% |

809,72 |

|

Experiment |

135,74 |

17,91 |

5,53% |

2455 |

0,99 |

33,08% |

2,430,65 |

|

|

Diff. (E/C) |

3,07% |

191,22% |

-2,64% |

5,91% |

182,86% |

-23,94% |

200,18% |

|

|

Market 2 |

Control |

187,22 |

0,86 |

11,12% |

1683 |

0,1 |

55,62% |

160,47 |

|

Experiment |

194,83 |

2,64 |

11,45% |

1701 |

0,30 |

49,01% |

515,08 |

|

|

Diff. (E/C) |

4,06% |

206,98% |

2,97% |

1,07% |

200% |

-11,88% |

220,98% |

|

|

Market 3 |

Control |

105,74 |

2,17 |

7,90% |

1339 |

0,17 |

40,64% |

229,33 |

|

Experiment |

99,97 |

5,27 |

7,06% |

1415 |

0,37 |

37,39% |

526,77 |

|

|

Diff. (E/C) |

-5,46% |

142,86% |

-10,63% |

5,68% |

117,65% |

-8% |

129,7% |

|

|

Market 4 |

Control |

707,95 |

3,08 |

6,53% |

10843 |

0,20 |

49,79% |

2,180,81 |

|

Experiment |

731,89 |

9,07 |

6,25% |

11704 |

0,57 |

44,54% |

6,635,23 |

|

|

Diff. (E/C) |

3,38% |

194,48% |

-4,29% |

7,94% |

185% |

-10,54% |

204,26% |

|

|

Market 5 |

Control |

1603,32 |

1,51 |

7,68% |

20868 |

0,12 |

56,66% |

2,414,59 |

|

Experiment |

1614,11 |

3,98 |

7,52% |

21463 |

0,30 |

48,69% |

6,430,38 |

|

|

Diff. (E/C) |

0,67% |

163,58% |

-2,08% |

2,85% |

150% |

-14,07% |

166,31% |

|

|

Market 6 |

Control |

617,12 |

1,96 |

6,04% |

10218 |

0,12 |

52,17% |

1,211,11 |

|

Experiment |

586,26 |

4,52 |

5,89% |

9960 |

0,27 |

46,92% |

2,651,77 |

|

|

Diff. (E/C) |

-5% |

130,61% |

-2,48% |

-2,52% |

125% |

-10,06% |

118,95% |

|

|

Market 7 |

Control |

494,33 |

1 |

10,71% |

4615 |

0,11 |

54,89% |

492,7 |

|

Experiment |

597,31 |

3,5 |

12,1% |

4937 |

0,42 |

46,8% |

2,091,27 |

|

|

Diff. (E/C) |

20,83% |

250% |

12,98% |

6,98% |

281,82% |

-14,74% |

324,45% |

|

|

Market 8 |

Control |

73,46 |

3,57 |

3,19% |

2303 |

0,11 |

53,43% |

261,89 |

|

Experiment |

185,64 |

3,35 |

4,74% |

3915 |

0,16 |

50,56% |

621,06 |

|

|

Diff. (E/C) |

152,71% |

-6,16% |

48,59% |

70% |

45,45% |

-5,37% |

137,15% |

|

|

Market 9 |

Control |

452,77 |

1,05 |

11,52% |

3931 |

0,12 |

57,64% |

477,36 |

|

Experiment |

457,99 |

3,47 |

11,20% |

4091 |

0,39 |

49,35% |

1,587,50 |

|

|

Diff. (E/C) |

1,15% |

230,48% |

-2,78% |

4,07% |

225% |

-14,38% |

232,56% |

|

|

Market 10 |

Control |

703,15 |

0,55 |

8,52% |

8251 |

0,55 |

52,53% |

4,527,34 |

|

Experiment |

743,23 |

0,95 |

8,53% |

8717 |

0,95 |

42,92% |

8,323,35 |

|

|

Diff. (E/C) |

5,7% |

72,73% |

0,12% |

5,65% |

72,73% |

-18,29% |

83,85% |

*Все финансовые показатели (CPC, CPA и Cost) — измененные величины, не представлены ни в одной из существующих валют и не соответствуют реальным суммам, потраченным на рекламу, но все так же позволяют провести сравнение по принципу «<|>|=». Реальные финансовые данные разглашать не позволяет NDA.

Краткий обзор результатов:

- Во всех кампаниях увеличилась средняя цена клика (от 50 до 280%), снизился CTR (от 5 до 25%), выросли расходы (от 83 до 325%).

- В девяти из десяти кампаний увеличилось количество кликов (от 1 до 70%) и выросла цена конверсии (от 70 до 250%).

- В восьми кампаниях увеличилось количество транзакций (от 0,5 до 152%)

- В семи кампаниях снизился коэффициент конверсии (от 0,1 до 10%).

В итоге главная цель эксперимента вроде бы достигнута — в восьми из десяти кампаниях действительно наблюдается рост числа транзакций. Однако, принимая во внимание снижение CR в семи кампаниях, а также увеличение числа кликов в девяти, легко понять, что это произошло экстенсивным способом: трафика пришло больше, транзакций стало больше.

Но какой ценой. Расходы на кампании выросли настолько, что чистый убыток от эксперимента составил порядка 20% от начального бюджета. Если учесть всего лишь 5-процентный прирост числа транзакций, автоматическая стратегия, мягко говоря, провалилась. Оговорюсь, что эксперимент длился ровно 30 дней и был отменен на 15 дней раньше, чем предполагалось, так как потери могли быть еще выше.

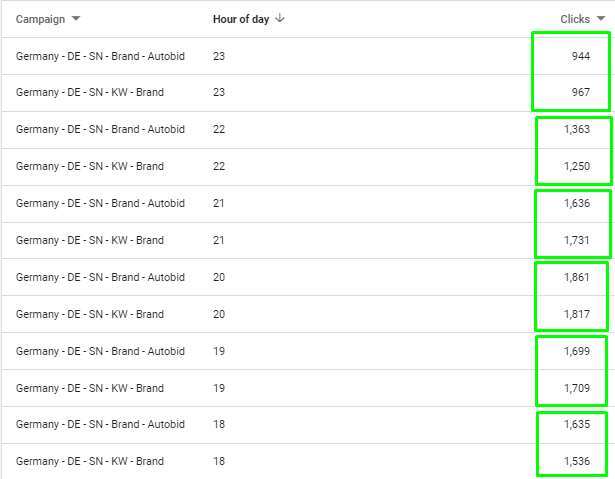

Осмотрев разницу в работе контрольных и экспериментальных кампаний, я пришел к выводу, что главным параметром, управляемым автоматической стратегией, стала — сюрприз! — цена клика. Да, именно в этом параметре наблюдается наибольшая вариация. Согласно отчетам по устройствам, регионам показа и времени суток — все осталось практически без изменений. Для наглядности приведен пример из кампании для самого крупного рынка Market 5, а зелеными прямоугольниками соединены суммы кликов для одних и тех же устройств/времени суток/локаций

Учитывая, что у контрольных и экспериментальных кампаний было >99% процента полученных показов, первая средняя позиция и не было конкурентов, я по сих пор не понимаю, как так вышло, что фактически списываемая цена клика выросла от 50 до 280%. Возможно, аккаунт-менеджер от Google, который помогает в работе над этим проектом, прояснит ситуацию.

Ни в одной из кампаний и стран не был достигнут достаточный рост количества конверсий, при котором можно было бы закрыть глаза на рост их стоимости. Исключением из общей картины стала кампания Market 8 — по Португалии. Причиной может быть как сравнительно малый относительный объем выборки при тестировании (третье место с конца по количеству кликов), так и эффект «низкой базы» по CR — исторически, еще до эксперимента, он был более чем в два раза ниже, чем средний по группе кампаний.

Подводя итоги, хочу сказать следующее:

-

Всегда думайте, за счет изменения каких параметров система сможет улучшить показатели. Если, как в примере, речь идет о кампаниях, где нельзя «жонглировать» максимальными ставками по десяткам и сотням ключевых слов, если нет конкурентов, с которыми нужно бороться, если нет очевидного «потенциала роста» (процент полученных показов близок к максимуму, а CTR > 40%), то крайне вероятно получение результатов, схожих с итогами моего эксперимента.

-

Не стройте иллюзий насчет механизма работы автоматических стратегий. Это не магия и не чудотворство. По словам самой Google, это машинное обучение. И когда запускается эксперимент, подобный моему, и ожидается увеличение числа конверсий, с помощью стратегии «Максимум конверсий», действительно получается больше конверсий. Однако граничный прирост прибыльности кампаний оказался отрицательным, и это ошибка рекламодателя, которая называется «недооцененным риском».

-

Google Ads — один из главных источников дохода для компании Google. И, разумеется, он ориентирован на прибыль. Потому даже не надейтесь, что Google Ads работает в пользу рекламодателя. Он работает в свою пользу, а задача PPC-специалиста сделать так, чтобы цели его клиента и Google Ads максимально совпадали.

-

Никогда не бойтесь экспериментировать. При смене менеджмента какого угодно объекта обычно наблюдается кратковременный спад. Но после одного дня спада делать выводы, что что-то не сработало, бессмысленно. Да, не всегда есть свободные ресурсы (как в примере выше), чтобы так рисковать. Но сделай я тот же эксперимент не на десяти кампаниях, а на одной, потери составили бы около 10-15% от номинала, что не так уж и болезненно с учетом суммы бюджета всех кампаний. И с вероятностью 90% я получил бы тот же результат, так как только одна кампания имеет отличную от других картину результатов.

-

Доверяй, но проверяй. Признаюсь, за 30 дней эксперимента, я проверял статус всего лишь 4–5 раз из-за большого количества задач в тот период. Однако заподозрил «неладное» я уже спустя 10 дней после старта. Разумеется, отменять их так рано я не собирался, но регулярная проверка результатов без предрассудков и страха поможет вам оперативно понять, чем вы рискуете и как долго можете ждать достоверных результатов.

Ваша реклама на ppc.world

от 10 000 ₽ в неделю

Читайте также

Как и зачем российским компаниям запускать рекламу в Google Ads в 2024 году

Как упростить работу в Директе: инструменты автоматизации Директ Коммандер, Excel, API, Telegram

Последние комментарии